新闻资讯

苹果新专利大幅提升XR设备视线追踪精度,校正根本性误差

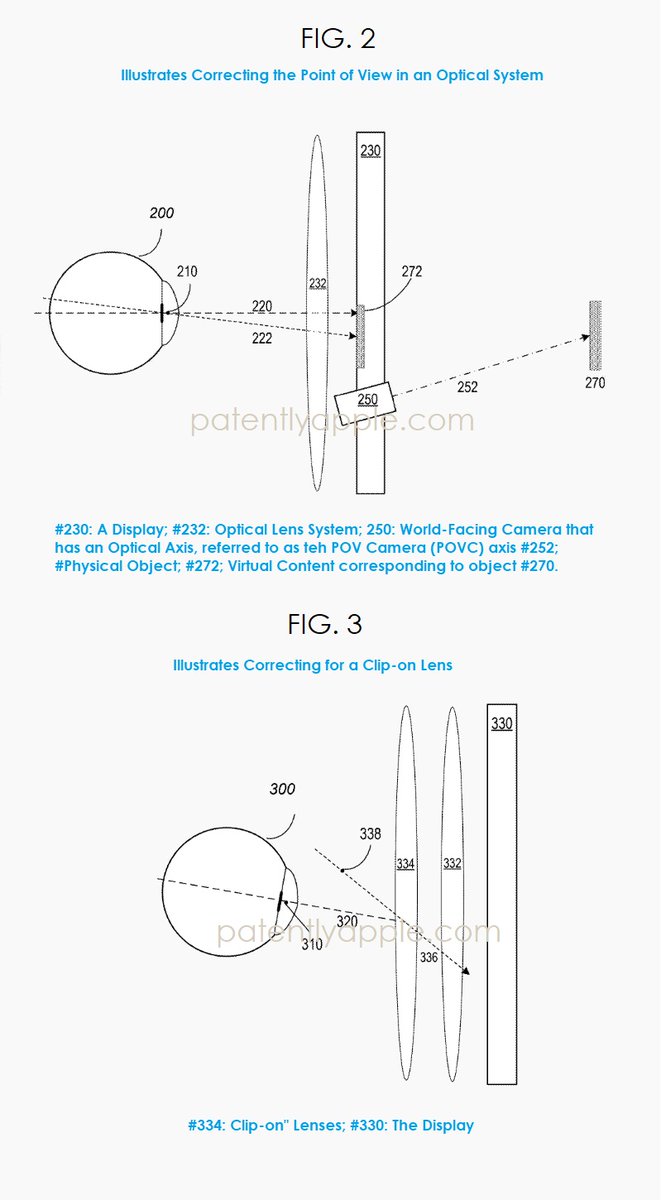

近日,苹果一项新视线校正系统专利曝光,旨在大幅提升AR眼镜、头显等XR设备的视线追踪精度。苹果的这项发明提出了一种估算真实视轴的方法,并利用它实时校正视线追踪结果。通过估算真实视轴,而非单纯依赖光轴,系统可减少系统性视线追踪误差,显著提升以下场景精度:

此次苹果于XR设备上所拥有的新专利,精准命中了当下眼动追踪技术的关键痛点。千万别小瞧那细微的一点点视线误差,于虚拟现实环境里,它极有可能是致使你感到头晕或者按不准按钮的罪魁祸首。苹果所提出的方案致力于从根本源头去化解这个难题。

重新定义你的注视点

之所以传统眼动追踪会存在误差,是由于它默认你的视线是从眼球中心笔直地穿出来的。然而实际上,人眼中真正用于看清事物的那条线,鉴于视网膜结构的缘故,与这个默认线存在着一个微小夹角。苹果的专利所要做的就是找到这个属于你个人的真实夹角。

这个过程出现于设备初始化的校准时期,系统届时会要求你逐个注视屏幕里的若干光点,与此同时急速捕捉你眼球在异样角度时的状态,凭借这些被获取的数据点,算法便能够算出你的视轴相对于光轴的精准偏移量。

校准不只是走形式

不少人认为设备校准属于那种可有可无的步骤,然而在苹果的构想里,这却是提高精度的核心所在。系统并非单纯记录一个固定的差值,而是去构建一个专属于你个人的眼球光学结构模型。此模型会涵盖你的角膜弧度、晶状体位置等生物特征。

凭借这个模型,设备得以理解,当你的眼球转动至不同角度之际,真切视线该依何方式进行计算。这恰似为设备配备了一副专属你的“视觉解码器”,致使它在任何时刻都能够精准判定你所注视之处。

虚实融合的基石

于增强现实当中,一个虚拟的茶杯可不可以稳稳放置于真实的桌面上,这取决于设备针对你视线深度所作的判断。要是视线方向存在丝毫偏差,那么这个茶杯会如同粘不住那般在桌面上晃动。苹果的此项技术便是为了消除这种违和感。

当视线追踪精准到足够程度,系统方可于你注视的精确地方,去渲染出清晰的虚拟内容。这不但能够提升增强现实体验的真实感哟,而且能让混合现实里的交互,像用手指点按虚拟按钮这种,感觉愈发像是在操作真实的物体呢。

戴眼镜用户的福音

对于那些有佩戴近视镜需求的用户而言,当前的头显体验常常会大打折扣。外挂的矫正镜片会改变光线传递的路径,进而干扰原本的眼动追踪系统促使精度下降。苹果所采用的方案专门顾及到了这一方面。

专利里提及,系统会把矫正镜片的光学特性纳入模型计算,它会模拟光线穿过你所佩戴的镜片进而进入头显传感器的全过程,以此在算法层面抵消镜片带来的干扰,确保戴眼镜的用户也能够获得同样精准的视线追踪体验。

动态渲染的性能优化

精确的视线追踪乃是达成注视点渲染技术的开端,这个技术会依照你的注视点,于中心范围之内开展高清渲染,然而在边缘范围降低画质这样由此极大地节省图形处理器的资源,视线不准确,此优化便无法进行。

若系统对您的注视点给出错误判断,那么便有可能于您看不清之处耗费算力去开展高清渲染,然而在您切实关注之地画质却粗糙。苹果所具备的校正技术能够使渲染资源始终聚焦于您的真实注视点之上,达成性能与画质的最佳平衡。

从校准到使用的持续同步

在这套系统里,精妙的地方在于校准,它不是一次性能够完成的。当你在日常使用设备期间,系统会把捕捉到的实时视线数据持续地代入到之前已经建立好的个人模型之中,以此来进行校正。这就表明,视线计算是一个处在动态修正状态下的过程。

即便长时间使用,这种实时同步机制亦能确保,哪怕设备在头上出现轻微位移,视线追踪的精度依旧得以保持。它使虚拟内容的生成与显示,跟你的实际视线变化始终维持高度一致,逐帧优化,进而提供稳定流畅的视觉反馈。

要是你认为,在这项技术最终得以落地的情况下,它究竟会率先现身于苹果的下一代头显之上,还是会出现在更为轻便的智能眼镜上面?欢迎于评论区去分享你自己的看法。